'AI 대부'는 왜 갑자기 구글을 떠났나

'AI 대부'는 왜 갑자기 구글을 떠났나

페이지 정보

작성자 최고관리자 작성일 2023-05-04 23:11 조회 7,367 댓글 0본문

천문학 박사 과정 학생인 케이트 디비아스키는 새로운 혜성을 발견한다. 기쁨에 겨운 그는 지도교수인 렌달 민디 박사에게 이 사실을 알린다. 민디 박사 역시 기쁜 마음으로 축하해 준다.

하지만 둘은 곧 공포에 사로잡힌다. 혜성의 궤도를 계산한 결과 조만간 지구와 충돌할 것이란 사실을 알게 됐기 때문이다.

둘은 NASA와 백악관에 이 사실을 알린다. 하지만 아무도 둘의 경고에 관심을 갖지 않는다. 결국 아무런 대비를 하지 않고 있던 지구는 혜성과 충돌해 멸망하게 된다.

2021년 개봉된 영화 ‘돈 룩 업’에 나오는 내용이다. 이 영화에서 다가올 재난을 경고하는 디비아스키와 민디 박사는 절박하다. 지구 종말이란 재앙을 막기 위해 분주하게 움직인다.

하지만 다른 사람들에겐 그저 우스꽝스럽게 보일 뿐이다. 대부분의 사람들은 황당무계한 얘기라는 반응을 보인다.

그런데 ‘인공지능(AI) 대부’ 제프리 힌튼 박사는 영화 ‘돈 룩 업’을 예사롭지 않게 받아들이고 있다. AI가 초래할 위험을 외면하는 지금 상황이 영화 속 장면과 유사해 보여서다. 10년 만에 구글을 떠나기로 결정한 힌튼은 MIT테크놀로지리뷰와 인터뷰에서 “현재 AI를 둘러싼 상황은 ‘돈 룩 업’과 비슷하다”고 경고했다.

■ AI, 인간 위협하는 단계됐다…푸틴 같은 사람이 악용할수도

뉴욕타임스는 지난 1일(현지시간) 힌튼이 구글을 떠나기로 했다는 소식을 특종 보도했다. 2013년 부사장 겸 엔지니어링 펠로우로 구글에 합류한 지 10년 만이다.

당시 힌튼은 자신이 창업한 AI 업체 DNN리서치가 구글에 인수되면서 함께 구글 가족이 됐다. 이후 10년 동안 힌튼은 구글의 AI 개발 작업을 진두 지휘해 왔다.

그랬던 힌튼이 갑작스럽게 ‘구글 퇴사’를 선언하면서 잔잔한 파문을 일으키고 있다. 하지만 구글 퇴사보다 더 놀라운 건 그가 밝힌 '퇴사 이유'다.

힌튼은 구글과 결별한 가장 큰 이유로 ‘AI의 위협’을 거론했다. 구글에 몸 담고 있으면 이 문제를 자유롭게 거론하기 힘들기 때문에 떠나는 쪽을 택했다고 말했다.

그는 “AI가 사람보다 더 똑똑해지기까지는 아직 상당한 시간이 필요할 것이라고 생각했지만 이젠 그렇게 생각하지 않는다”는 말도 했다. 심지어 AI 시스템에서 일어나는 일이 사람 뇌보다 더 나은 경우도 있다고 경고했다.

힌튼은 오픈AI가 내놓은 GPT-4를 보면서 그런 생각을 하게 됐다고 밝혔다. 그는 MIT테크놀로지리뷰와 인터뷰에서 “외계인이 지구에 착륙했는데, 그들이 아주 훌륭한 영어를 구사하다보니 사람들이 그 위협을 깨닫지 못하고 있는 것과 비슷한 상황이다”고 주장했다.

특히 힌튼이 두려워하는 것은 GPT-4 같은 뛰어난 기술이 사람을 죽이거나, 허위정보를 조작하는 등의 나쁜 행동에 동원될 가능성이 적지 않다는 점이다.

MIT테크놀로지리뷰와 인터뷰에선 좀 더 직접적인 이야기도 했다.

그는 “푸틴 처럼 사악한 많은 사람들이 이런 (똑똑한) 도구를 사용하려고 한다”면서 “그들은 이 도구들을 활용해 전쟁에서 승리하거나, 유권자들을 조종하려고 시도한다”고 주장했다.

이런 선언이 놀라운 건 단순히 그가 AI 분야를 대표하는 연구자란 이유 때문만은 아니다. 힌튼은 요즘 화제가 되고 있는 대용량언어모델(LLM)의 기반을 닦은 인물이다. 자신이 닦은 기반 위에 피어 오른 결실에 대해 '두려움'을 나타내고 있는 셈이다.

■ AI 4대 천황으로 유명…제자 중 한 명이 오픈AI 공동 창업자

제프리 힌튼은 앤드류 응, 요수아 벤지오, 얀 르쿤 등과 함께 ‘AI 4대 천황’으로 꼽힌다. 2018년엔 딥러닝 분야 연구 성과를 인정받아 컴퓨팅 분야 노벨상으로 불리는 '튜링상'을 받았다. 당시 공동 수상자가 르쿤과 벤지오였다.

AI 분야에 남긴 힌튼의 흔적은 훨씬 오래 전으로 거슬러 올라간다. 그는 'AI의 겨울'로 불리던 1980년대 중반에 역전파법(backpropagation)을 제안하면서 지금 우리가 알고 있는 AI 연구의 기반을 닦았다.

역전파법은 사람의 두뇌와 비슷한 방법으로 컴퓨터를 학습시킨다. 이 방법을 이용해 이미지를 구분하고, 문장에서 다음에 어떤 단어가 나올 지 예측하는 데 성공했다.

역전파법은 AI 암흑기를 끝내고 새로운 도약의 계기를 마련해줬다는 평가를 받고 있다. 이 방법은 챗GPT를 비롯한 많은 대용량언어모델(LLM)의 기반 기술이나 다름 없다.

당시 대학원생으로 힌튼과 함께 역전파법 논문을 썼던 일리야 수츠케버는 챗GPT를 만든 오픈AI 공동 창업자 중 한 명이다.

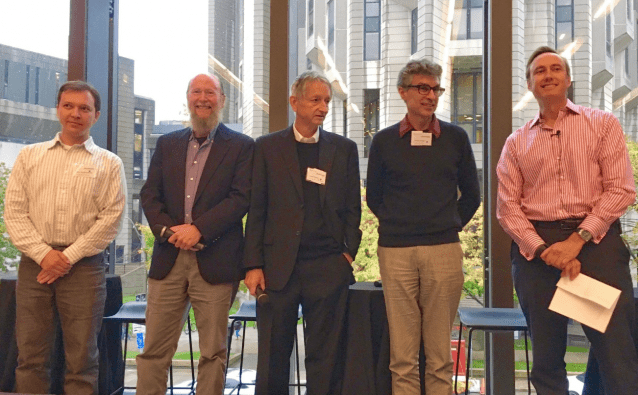

AI 연구자들과 함께 한 제프리 힌튼. 왼쪽 세번째가 힌튼이며, 바로 오른쪽이 요시아 벤지오다. (사진=위키피디아)

AI 연구자들과 함께 한 제프리 힌튼. 왼쪽 세번째가 힌튼이며, 바로 오른쪽이 요시아 벤지오다. (사진=위키피디아)

1980년대 이래 AI 연구를 주도해 왔던 힌튼은 왜 갑자기 ‘AI의 위협’을 경고하고 나선 것일까? 많은 국내 언론들은 ‘킬러 로봇’ 같은 사악한 분야에 악용될 가능성에 대해 경고한 것이라고 전해주고 있다. 물론 이런 부분도 적지 않다. 하지만 힌튼의 논리를 따라가보면 좀 더 심오한 철학적 사유와 맞닥뜨리게 된다.

사실 힌튼은 오래 전부터 AI 윤리를 강조해 왔다. 특히 군사 목적으로 사용할 경우엔 AI 윤리를 엄격하게 적용할 필요가 있다고 주장해 왔다.

MIT테크놀로지리뷰에 따르면 힌튼이 캐나다를 중심으로 연구 활동을 전개한 것도 이런 문제의식과 관련이 있다. 그래야만 미국 국방부의 영향을 받지 않고 자유롭게 연구비를 확보할 수 있을 것이라고 판단했기 때문이다. 제프리 힌튼은 토론토대학에 몸담고 있는 교수다.

이런 점 때문일까? 힌튼과 함께 튜링상을 수상했던 얀 르쿤은 "힌튼이 구글을 그만둔다는 사실을 미리 듣지는 못했다"면서도 "하지만 그런 결정이 놀랍지는 않다"고 말했다.

힌튼은 구글에 사표를 제출하기 며칠 전 MIT 테크놀로지 리뷰와 인터뷰를 했다. 2일 공개된 이 기사에는 힌튼이 왜 AI에 대해 두려움을 느끼고 있는지 잘 전해주고 있다.

흔히 인간은 새로운 것을 금방 배우는 반면 챗GPT 같은 LLM은 엄청난 데이터를 학습해야만 한다는 것이 일반적인 상식이다.

하지만 힌튼은 MIT테크놀로지리뷰와 인터뷰에서 '퓨 샷 러닝(few-shot learning)' 가능성에 대해 언급했다. 사전 학습된 LLM들은 몇 가지 사례만으로도 새로운 것을 굉장히 빨리 배울 수 있다는 것이다. 그런 다음 이렇게 학습한 것들을 조합해 전혀 배운 적 없는 주장을 내세우기도 한다. 이렇게 되면 인간의 장점은 완전히 사라지게 된다는 것이 힌튼의 주장이다.

흔히 챗GPT 같은 LLM의 심각한 결함 중 하나로 ‘환각(hallucinations)’을 꼽는다. AI가 ‘아무말 대잔치’를 하는 상황을 묘사한 말이다.

하지만 힌튼은 ‘환각’ 보다는 ‘작화증(confabulations)’이란 용어를 더 선호한다. ‘작화증’이란 ‘자기의 공상을 실제 일처럼 말하면서 자신은 그것이 허위라는 것을 인식하지 못하는 증상’을 의미한다.

흔히 작화증은 기술에선 중요한 결함으로 간주한다. 하지만 힌튼은 사람간의 대화에서도 흔히 볼 수 있는 현상이라고 주장한다. 그는 MIT테크놀로지리뷰와 인터뷰에서 “작화증은 인간 기억력의 특징 중 하나다”면서 “따라서 이런 모델은 인간과 비슷하게 작동하는 셈이다”고 강조했다.

힌튼은 똑똑한 기계들의 다음 단계는 자신만의 ‘하위목표(subgoal)’를 설정하는 것이라고 주장한다. 여러 발생 상황이나 변수를 고려해 AI가 하위 목표를 자체적으로 설정한다는 의미다.

그는 “하위목표를 설정하게 될 경우 로봇들이 ‘더 많은 전력을 갖자. 모든 전기를 내 칩으로 우회시키자’고 하는 상황이 발생할 수도 있다”고 경고했다. 힌튼의 이런 경고는 암울한 미래상을 그린 SF영화에서 우리가 흔히 보던 모습이다. AI가 인간의 통제 영역 바깥으로 나갈 수도 있기 때문이다.

■ 기술 분야 지도자들과 AI 위험 대비하는 활동 해 나갈듯

구글을 떠난 힌튼은 앞으로 어떤 활동을 하게 될까?

힌튼은 일단 AI 기술이 어떤 위험을 초래할 수 있는지에 대해 기술 분야 지도자들과 함께 작업하는 것을 최우선 과제로 꼽고 있다. 국제사회가 화학무기 사용을 제한하는 것과 같은 모델을 AI 연구에도 적용할 수 있을 것이라고 주장한다.

물론 AI 학자들이 이런 두려움에 모두 공감하는 것은 아니다. MIT테크놀로지리뷰에 따르면 또 다른 ‘AI 4대 천황’인 얀 르쿤은 힌튼의 이런 전망에 공감하면서도 “더 똑똑해진 기계가 인간성의 새로운 르네상스를 만들어낼 것”이라고 주장한다.

기계가 더 똑똑하다는 이유만으로 인간을 지배할 것이라는 가정에는 동의하지 않는다는 것이다. 얀 르쿤은 현재 메타의 AI 정책을 총괄하고 있다.

(사진=지디넷닷컴)

(사진=지디넷닷컴)

2018년 튜링상을 공동 수상했던 요시아 벤지오는 힌튼과 얀 르쿤의 중간 정도 관점을 갖고 있다고 MIT테크놀로지리뷰가 전했다.

AI 흐름을 주도해 왔던 제프리 힌튼의 ‘경고 메시지’는 적지 않은 울림을 몰고 왔다. 일론 머스크 같은 비즈니스맨의 경고와는 차원이 다르기 때문이다.

영화 ‘돈 룩 업’을 보고 격하게 공감했다는 힌튼의 주장에 대해 AI 업계와 학계는 어떻게 반응할까? 군비경쟁을 방불케하는 AI 전쟁을 벌이고 있는 빅테크들은 또 어떤 행보를 보일까?

이런 질문을 던지면서 갑자기 영화 ‘돈 룩 업’을 한번 더 보고 싶다는 생각을 하게 됐다.

등록된 댓글이 없습니다.